Decrypted

The Virtru Blog

Tips, takes, and expertise for the data-centric security practitioner

The Virtru Blog

Tips, takes, and expertise for the data-centric security practitioner

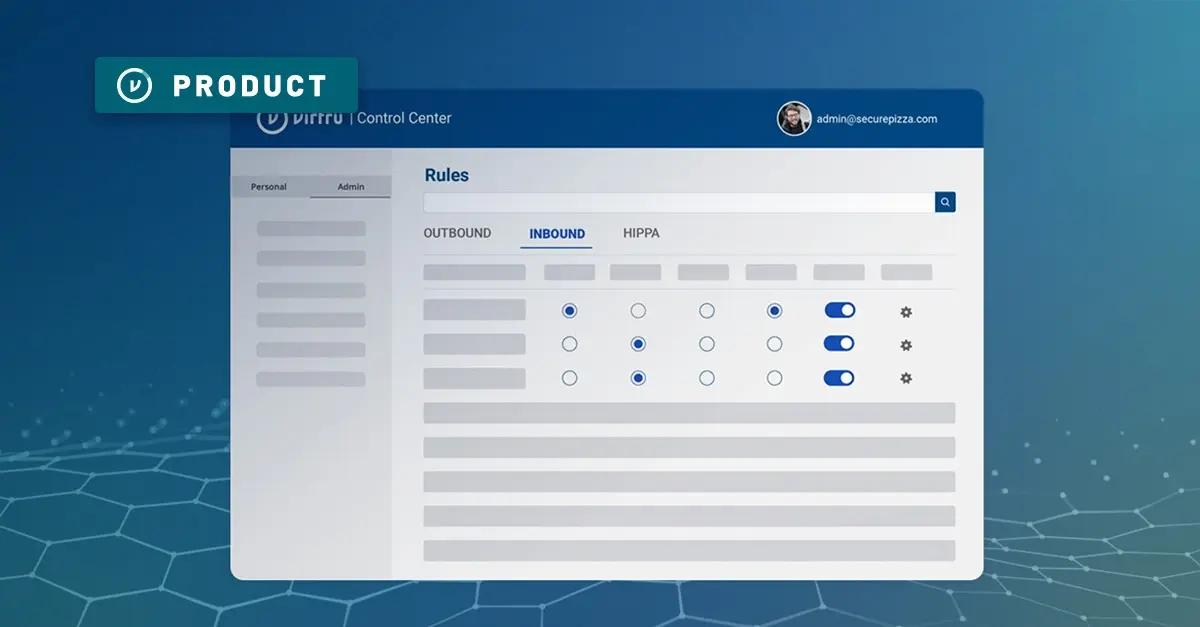

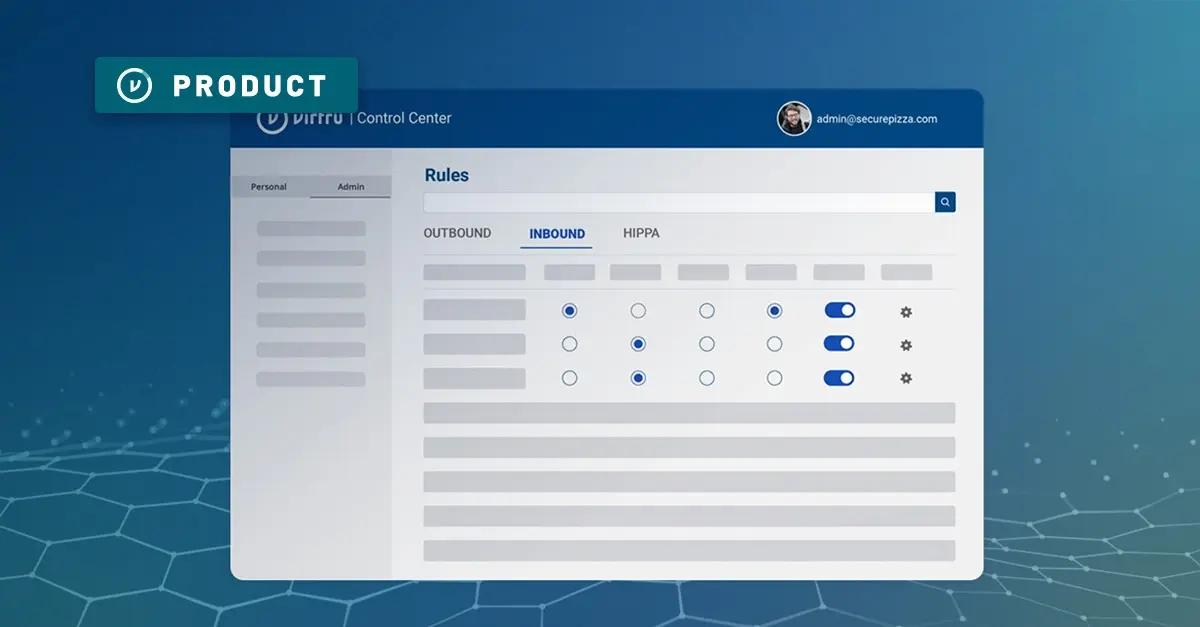

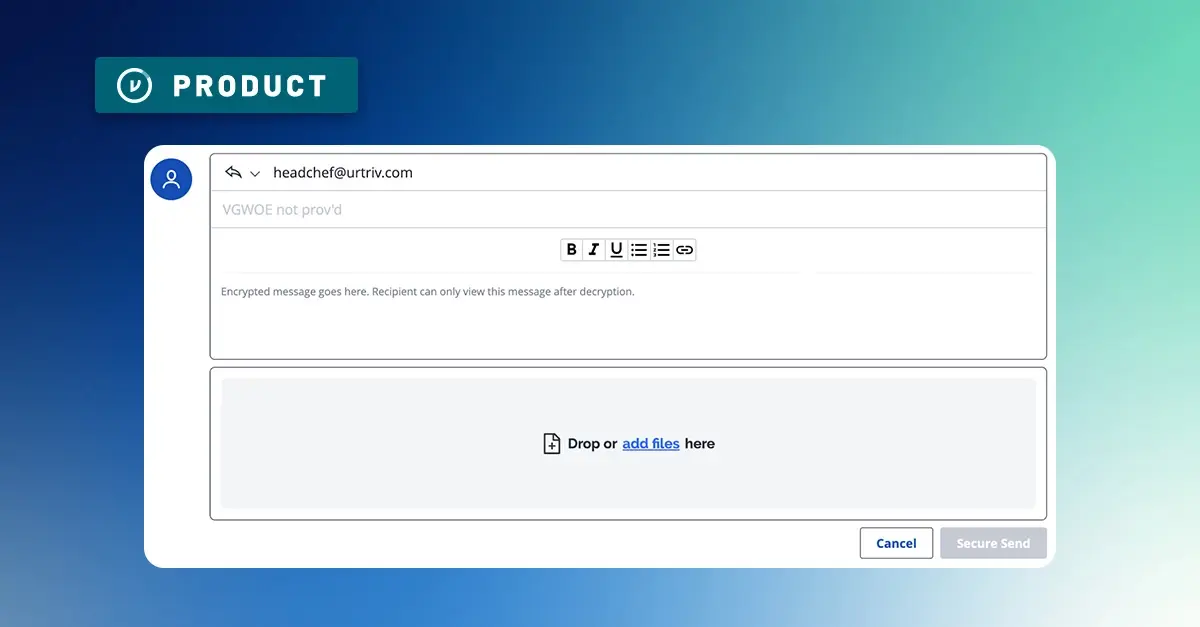

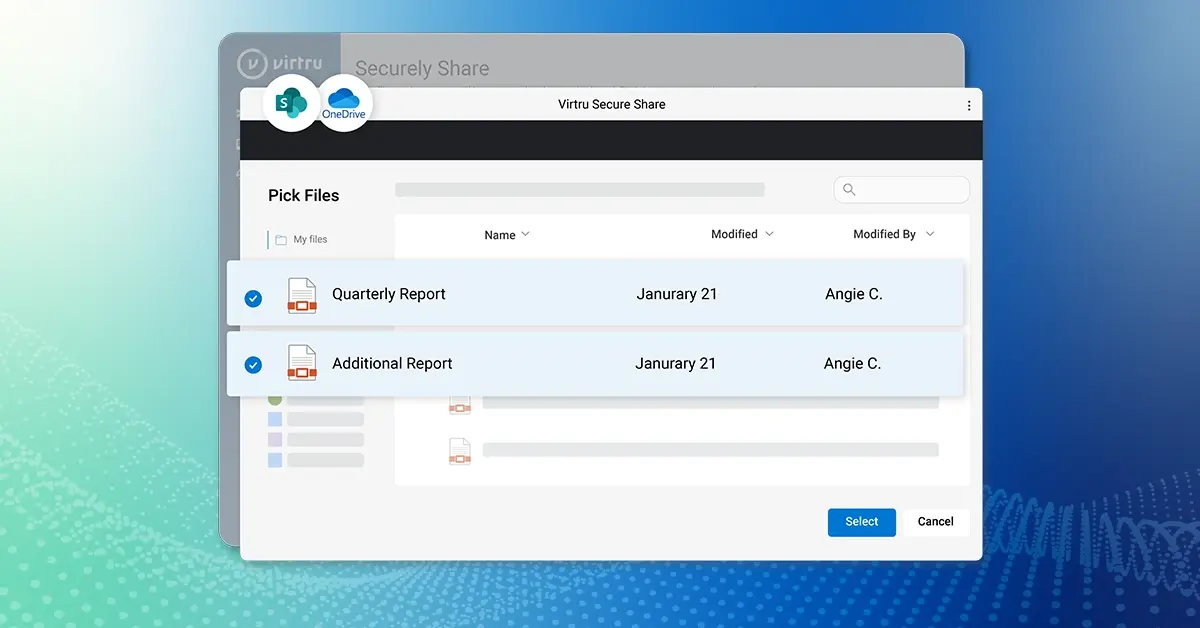

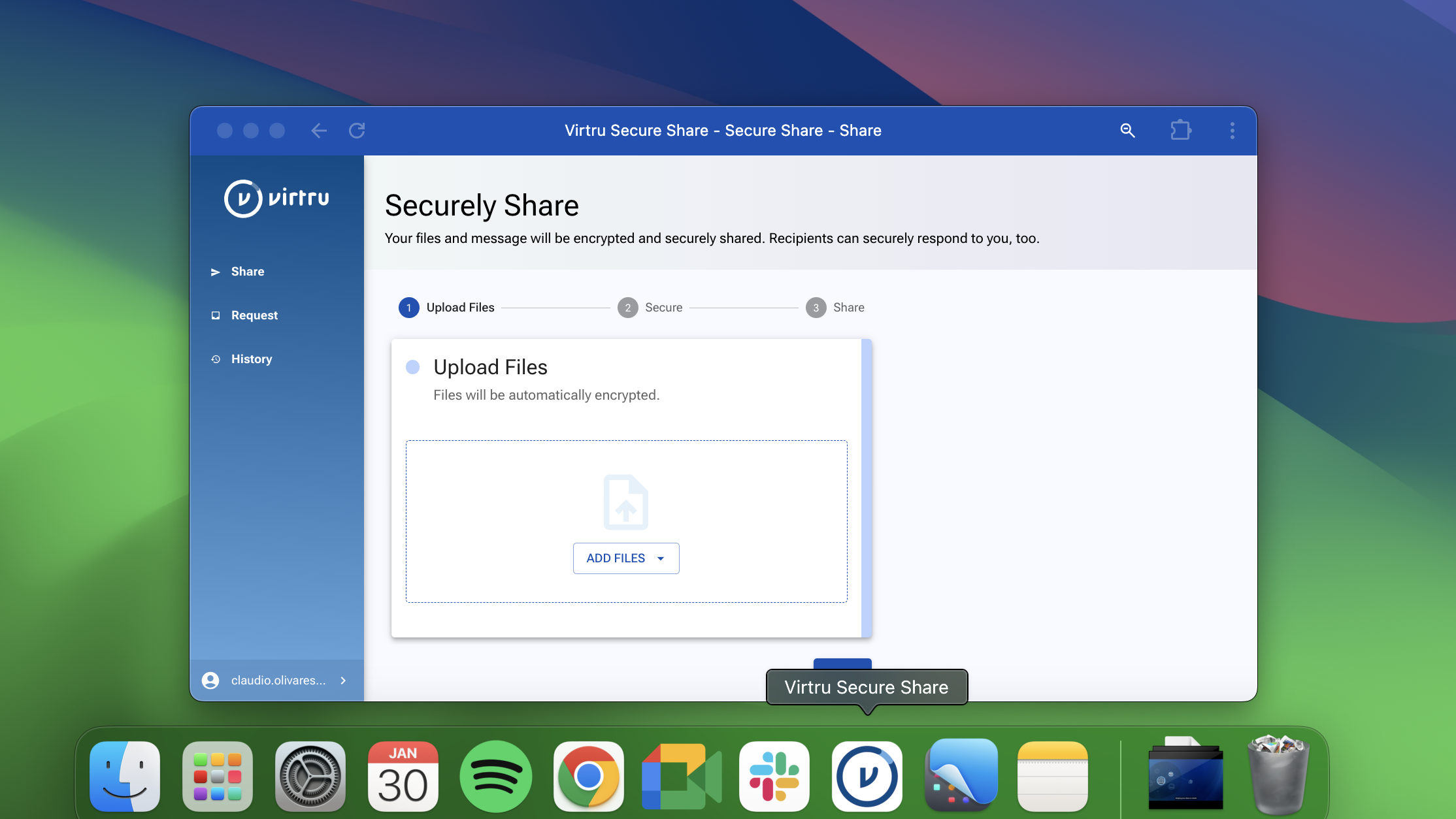

Your organization deserves complete data control—not just over what goes out, but what comes in too. That's why Virtru's Data ...

Read Post

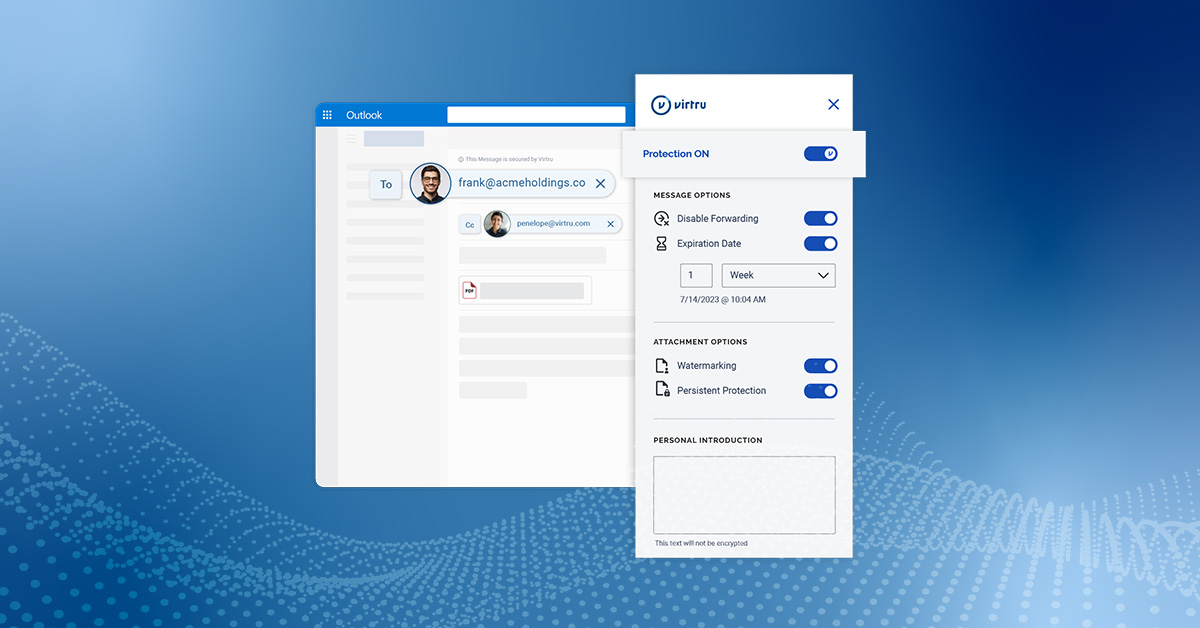

This blog draws from a presentation by Virtru's Co-Founder Will Ackerly and SVP of Product & Engineering Dana Morris at RSA ...

Read Post

Washington has no shortage of reform directives. However, every so often, an idea emerges that is both immediately practical and ...

Read Post

type

industry

compliance

product

Contact us to learn more about our partnership opportunities.